这依然是一篇旨在进行基础回顾的文章,本期我们重点聊聊智能驾驶系统中不可或缺的传感器。

一般来说,智驾系统主要依赖以下几类传感器:

- Camera (相机)

- Lidar (激光雷达)

- Radar (毫米波雷达)

- USS (超声波雷达)

当然,市面上还有一些其他的变体传感器,例如 4D Millimeter-wave Radar (4D 毫米波雷达)、双目相机等,但它们本质上都属于上述类别的延伸或变种,在此不做过多赘述。

💡 在深入了解各个 Sensor 之前,我们必须先达成一个共识:所有 Sensor 的存在,都是为了服务于智驾算法的。

或者说得更绝对一点,主要是服务于其中的 感知 (Perception) 模块。正如上一篇文章所提到的,在智驾算法还明确划分模块的时代,感知就是车辆的「眼睛」,负责从混乱的物理世界中提取有用的信息。因此,所有的传感器升级和选型,归根结底都是为了让感知模块能更好、更准确、更及时、全天候地感知周围环境。

为了不让文章显得冗长乏味,我将硬核的 传感器基本原理 部分放在了文章最后,感兴趣的读者可以跳到文末阅读。

为什么是这几种传感器?

基于上述共识,我们来看看为什么在这些年的技术迭代中,最终沉淀下来的是这几种传感器组合。

1. Camera (相机)

相机大家都见过,图略~

早期上车主要是作为倒车影像等辅助功能 (ADAS) 出现。后来,随着深度学习在图像领域(Computer Vision)的爆发,相机自然而然地被用于 2D 目标检测。

然而,车辆行驶在三维世界中,我们需要知道障碍物距离车有多远、是什么形状、体积多大。早期的 2D 检测算法无法直接提供这些 3D 信息,于是工程师们只能结合 先验假设 和 人为规则 进行后处理。例如:假设车道线是平行的、路面是平坦的、某种车型的宽度是固定的。基于这些假设,从 2D 图像反推 3D 信息(IPM 逆透视变换等)。

局限性:这种方法泛化能力差,只能在高速、高架等结构化道路的限定场景下工作,一旦遇到非标准路况(如坡道、异形车),系统就容易失效。

转折点:大概在 2021 年左右,以 Tesla 为首的厂商开始大力推行「纯视觉」方案,利用 BEV (Bird’s Eye View) 和 Transformer 等算法技术,实现了直接从多路摄像头图像中感知 3D 空间信息。这不仅让摄像头测距成为可能,且随着数据量的积累,精度也越来越高。

当然,除了 Tesla,早期也有基于双目相机(利用视差原理测距)的方案,但这些更多是在已有框架下的修补,而 BEV+Transformer 则是算法层面的降维打击。

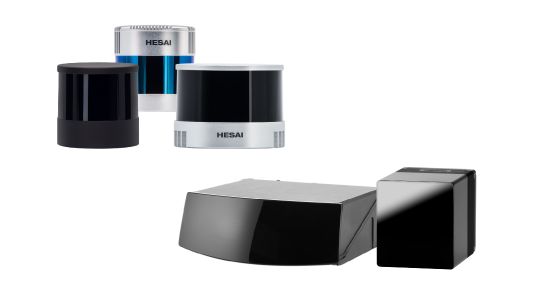

2. Lidar (激光雷达)

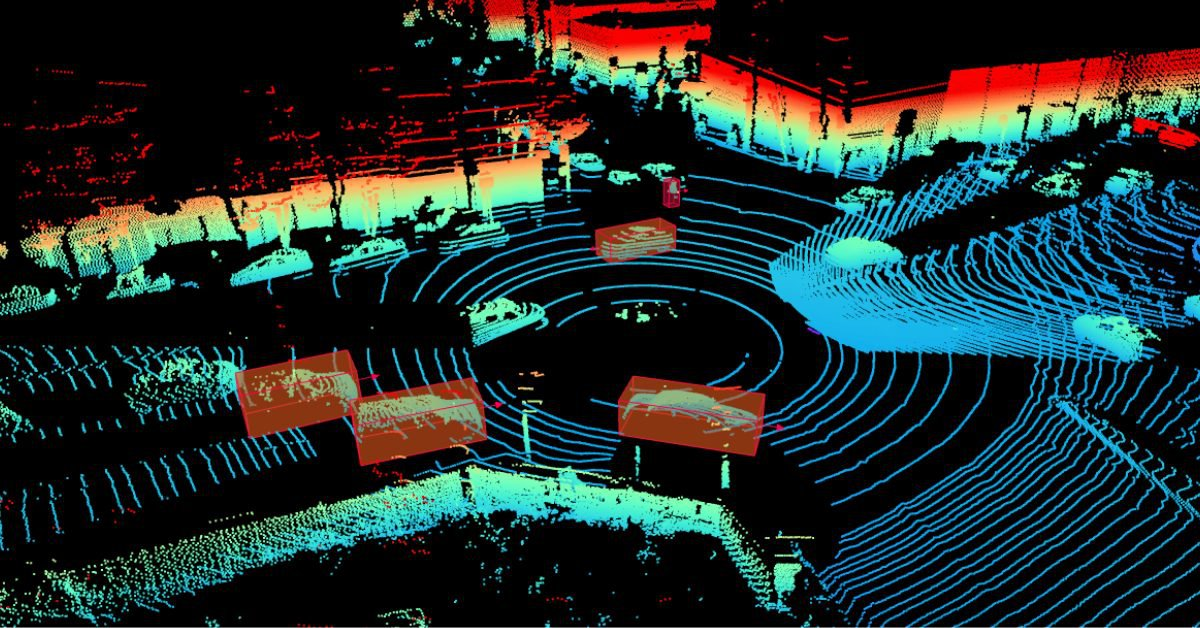

Lidar 不同于相机,它通过发射激光束并接收回波,可以直接获得障碍物的 精确位置信息 (3D 点云) 和大致轮廓。

优势:它简单粗暴地解决了相机在算法突破前无法准确测距的痛点。因此,在智驾发展的早期(Robotaxi 阶段),Lidar 几乎是所有智驾公司的必选。没有 Lidar,车就没法安全地跑。

劣势:贵。早期一套 Velodyne 的 128 线机械式激光雷达,坊间戏称「顶着一套二线城市的房在跑」。当然,对于融资烧钱的初创公司来说,验证技术可行性比成本更重要。

现状:到了 2025 年末,Lidar 的价格已经被打到了非常可接受的区间(千元级),成为了国内许多中高端车型的「标配」。甚至在宣发上,「有 Lidar = 智驾能力更强」 似乎已经成为了某种市场共识。

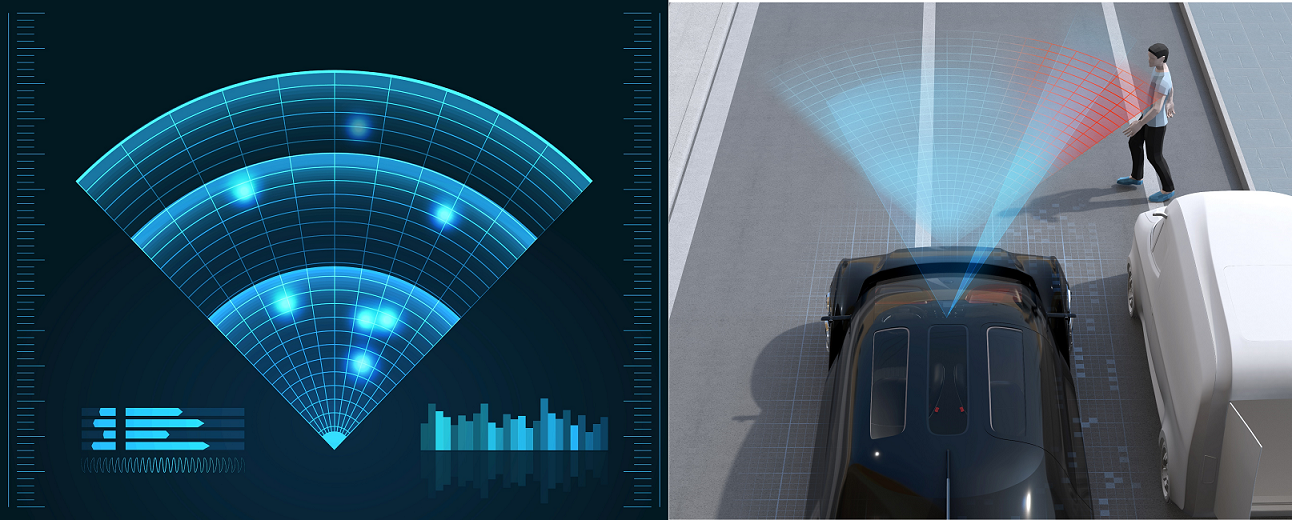

3. Radar (毫米波雷达)

Radar 的历史非常久远,是上一代燃油车中高级辅助驾驶(如 ACC 自适应巡航)的核心传感器。

特点:它就像一个拿着望远镜但高度近视且散光的人。它能探测到很远的物体,能直接测速(多普勒效应),且不受雨雾天气影响。

劣势:分辨率太低。它知道前面「有东西」,但很难分清是路边的静止护栏还是停着的车;它也无法区分高度(传统的 3D Radar),容易把地上的井盖或空中的路牌误报为障碍物(幽灵刹车)。(就如同上图,Radar 感知到的障碍物就是一个个点,难以做精细化的感知)

现状:虽然它可以用来做 AEB (自动紧急制动) 等兜底功能,但在追求高阶智驾(精准感知)的当下,传统 Radar 显得「食之无味,弃之可惜」。Tesla 甚至在 2021 年直接移除了 Radar。

4. USS (超声波雷达)

大家最熟悉的「倒车雷达」,发出「嘀嘀嘀」报警声的就是它。

特点:极其便宜,近距离测距非常准(尤其是玻璃等透明物体,Lidar 和 Camera 容易失效)。

现状:主要用于低速泊车场景。但在高阶智驾中,随着视觉算法对近距离感知能力的提升(如 Occupancy Network),USS 的作用也在逐渐被边缘化。

纯视觉 vs. 融合感知:路线之争

基于上述分析,进入高阶智驾「决赛圈」的核心传感器其实就剩下 Camera 和 Lidar 了。行业内也分化为两派:「All-in 纯视觉派」 和 「多传感器融合派」。

各自的理由:

- 纯视觉派 (Tesla, 极越, 小鹏 P7+ 等):

- 既然人类只靠眼睛(视觉)就能开车,那车也应该可以。

- 第一性原理:视觉包含的信息量最丰富(纹理、颜色、语义),是感知的上限。

- 成本最低,利于大规模量产和数据闭环。

- 融合派 (华为, 理想, 蔚来 等):

- 在同样的相机基础上,多一个 Lidar 肯定更好。Lidar 提供精确的深度信息作为「真值」或安全冗余。

- 「小孩才做选择,我全都要」。既然用户买单,为什么不给多一层安全保障?

互相的质疑:

- 反纯视觉:人眼有几十亿年的进化红利,且人脑的处理能力目前算法还达不到。即便算法达到了,相机在极端光照(强眩光、极暗夜)、恶劣天气(暴雨、大雪)下就是物理级失效,这时候没有 Lidar 兜底就是玩命。

- 反融合:传感器不是越多越好。首先是贵;其次是 「多传感器冲突」 问题:当相机觉得没车,Lidar 觉得有车时,算法信谁?这种决策冲突反而可能导致体验下降。而且,依赖 Lidar 会让算法团队产生惰性,不再极致地挖掘视觉的潜力(Crutch 理论)。

我的观点

关于纯视觉方案:

- 算法的「奇点」何时到来? 虽然「马圣」的 FSD 已经迭代到了 V13/V14 版本,但在处理某些长尾 Corner Case 上,距离人类老司机的直觉判断可能还有差距。

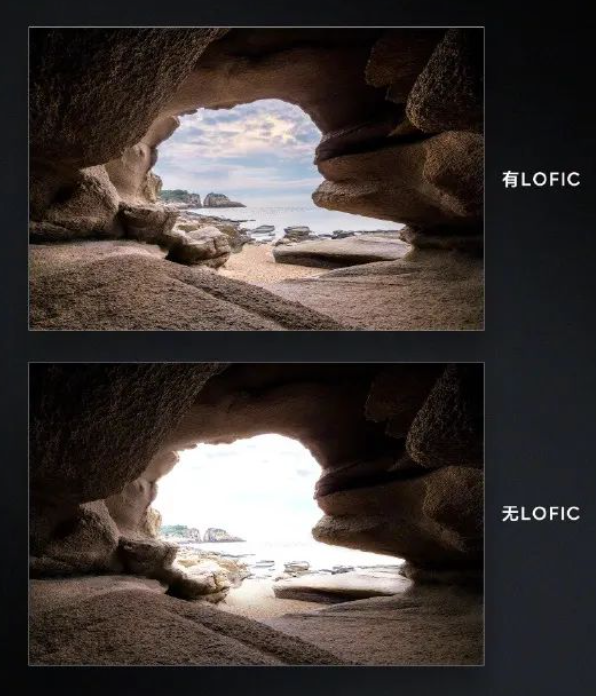

- 相机 vs. 人眼: 相机在某些方面其实早已超越人眼(如暗光环境下的感光能力、多视角的 360 度覆盖)。对于眩光、高动态范围(进出隧道)等问题,随着 LOFIC 等新型 CMOS 技术的普及(如小鹏 P7+ 采用的 AI 鹰眼视觉方案),硬件上的短板正在被补齐。

- 安全兜底: 纯视觉的最后一道防线往往不是看清了什么,而是基于对场景的理解进行「脑补」和预判,这需要极强的 AI 推理能力(端到端大模型)。

关于融合方案:

- 成本问题: 随着 Lidar 成本下探,融合方案的门槛在降低。但在 10-15 万级的走量车型上,纯视觉依然是唯一解。

- 阶段性最优: 在算法完全成熟之前,Lidar 确实是一道强有力的「安全气囊」,能解决很多视觉难以处理的异形障碍物(如侧翻的白车、路上的石头)。

- 未来的收敛: 当视觉算法足够强大(99.99% vs 99.999% 的区别)时,Lidar 可能会从「感知主传感器」退化为「安全冗余件」,甚至最终被移除。

总结建议:

- 对消费者:如果你是坚定的「技术信仰者」且对智驾边界有清晰认知,纯视觉车型的性价比极高;如果你是追求稳妥的「体验派」,且对价格不敏感,带 Lidar 的融合方案在当下确实能提供更安心的体验。

- 对从业者:纯视觉是技术的必经之路。现在的「挨骂」是为了未来的「爆发」。而且,智驾技术的终局是 AGI(通用人工智能),纯视觉的能力上限远未见顶。此外,纯视觉技术可以无缝迁移到机器人(Robot)领域,毕竟机器人大多装不起昂贵的 Lidar。

附录:传感器原理及技术趋势

为了让大家知其然也知其所以然,这里补充一下各传感器的核心原理及最新技术方向。

1. Camera (相机)

-

基本原理:基于小孔成像原理。光线穿过镜头(Lens),聚焦在感光元件(CMOS/CCD)上。感光元件上的每个像素点利用光电效应将光信号转换为电信号,最终生成数字图像。

-

技术痛点:传统相机最怕「大光比」场景(例如:进出隧道的瞬间,或者夜晚被对向远光灯直射)。这会导致画面一片死白(过曝)或死黑(欠曝),算法根本看不清。

-

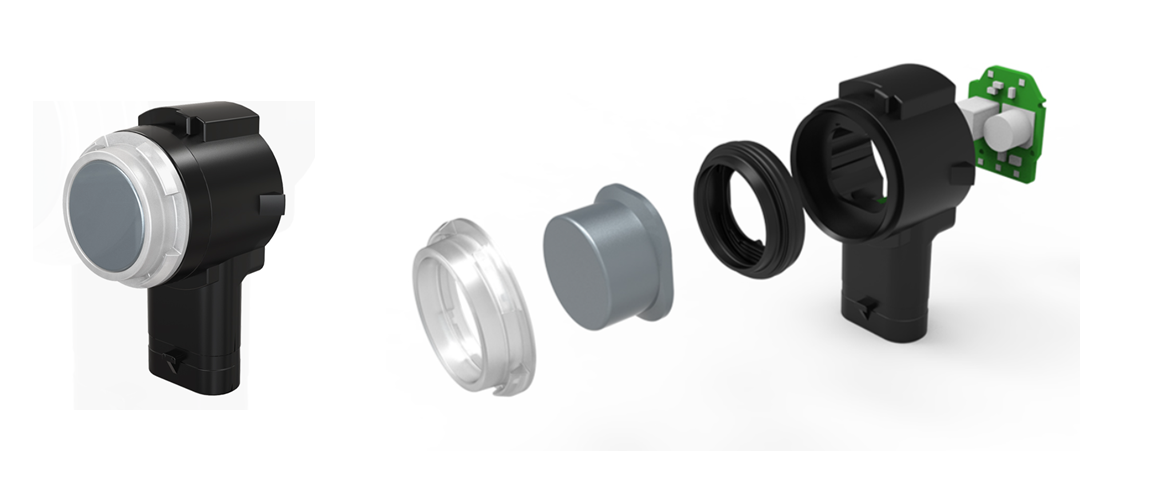

技术新趋势 (LOFIC):为了解决上述问题,车载相机正在引入 LOFIC (Lateral Overflow Integration Capacitor) 技术。

- 原理:在每个像素点旁边加一个「电容池」。当光线太强,电子产生过多快要溢出(过曝)时,多余的电子不会被丢弃,而是流入这个电容池存起来。读取信号时,将原来的信号+电容池的信号合并。

- 效果:极大地提升了 动态范围 (HDR)。使用了 LOFIC 技术的相机(如小鹏 P7+ 宣传的「鹰眼」系列),即使在逆光、强光直射下,也能清晰地拍出路况细节,让纯视觉方案在「看不清」这个问题上得到了硬件级的解决。

2. Lidar (激光雷达)

- 基本原理:ToF (Time of Flight,飞行时间法)。激光器发射一束激光,打到物体上反射回来被探测器接收。通过计算光束「由于反射而往返」的时间,乘以光速除以二,就能精确算出距离。

- 技术路线:

- 机械式 (Mechanical):最早期的「大花盆」。内部激光收发模块和镜片一起 360° 旋转。

- 优点:360° 无死角扫描。

- 缺点:体积大、贵、机械磨损严重,过车规(可靠性)极难。

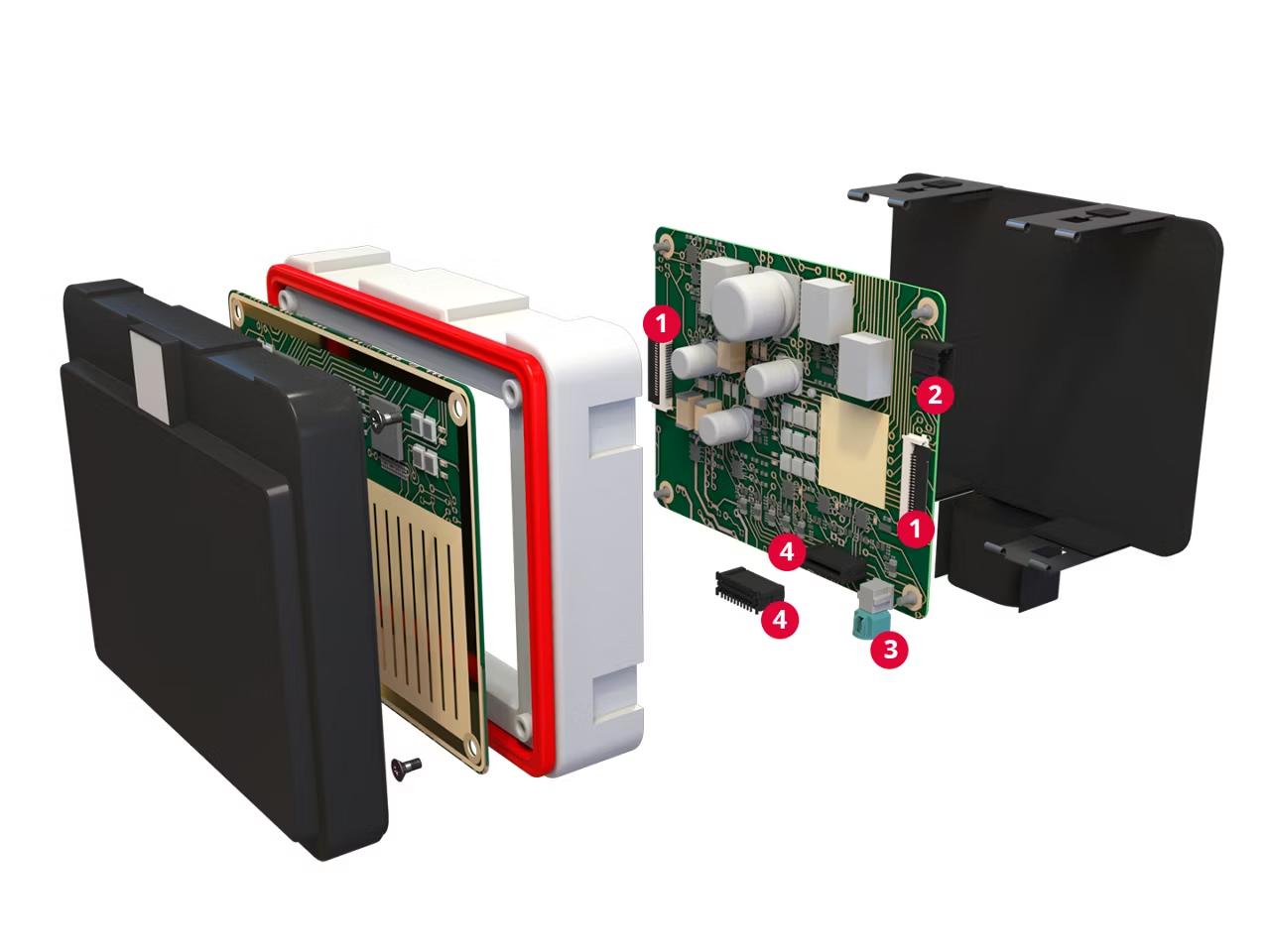

- 半固态 (Semi-Solid):当下的主流。包括 MEMS (微振镜) 和 转镜/棱镜 方案。激光收发模块不动,只让一个小小的镜子动来反射光束。

- 优点:体积小了,寿命长了,成本低了。

- 缺点:扫描角度有限(通常 120°),所以车上通常需要装 1-3 个来覆盖前方。

- 纯固态 (Solid-State):未来的方向。如 OPA (光学相控阵) 和 Flash。完全没有机械运动部件,像芯片一样控制光束方向。

- 优点:理论上最耐用、成本最低(量产后)。

- 缺点:目前技术还不成熟,Flash 方案探测距离短(主要用于补盲),OPA 制造难度极大。

- 机械式 (Mechanical):最早期的「大花盆」。内部激光收发模块和镜片一起 360° 旋转。

3. Radar (毫米波雷达)

-

基本原理:FMCW (调频连续波)。发射毫米波段的电磁波,利用 多普勒效应 (Doppler Effect)。通过检测发射波和回波之间的频率差,可以同时解算出目标的 距离 和 相对速度。

-

痛点:传统雷达没有「高度」信息,且角分辨率低。它分不清前方路面上是停着一辆车,还是这就只是一个金属井盖。

-

技术尝试 (4D Radar):

- 原理:增加了「高度」这一维度的探测能力,并大大增加了天线数量(MIMO),提高了分辨率。它能生成像 Lidar 一样密集的「点云」。

- 为何没成主流?:定位尴尬。比传统雷达贵,精度又不如 Lidar。在 Lidar 价格大跳水的背景下,4D Radar 的「性价比」优势被压缩了。目前更多作为一种高阶的冗余传感器存在。

4. USS (超声波雷达)

- 基本原理:发出超声波,计算回声时间(和 Lidar 的 ToF 类似,只是介质是声波)。

- 独特价值:虽然它「短视」(探测距离通常 < 5米),但它有一个 Lidar 和 Camera 都比不了的优势——能探测透明物体(玻璃)和吸光物体。

- 应用:除了泊车,目前在扫地机器人、泳池清洁机器人等低速、近距避障场景中依然广泛使用。