以 Tesla 和小鹏为主线,拆解车载相机的完整信号链路:CMOS Sensor(AR0136/AR0233/IMX490/OX08D10)、SerDes(GMSL2 串行器/解串器)、ISP 方案选择、PTP+CPLD 时间同步架构,以及当前仍未解决的工程问题和未来技术方向。

车载相机这个东西,表面上「就是个摄像头」,但从 CMOS 工艺到传输链路到时间同步,每一环都有大量 trade-off。这篇文章以 Tesla 和小鹏的选型演进为线索,把车载相机从传感器到域控制器的完整链路拆开讲一遍。

相机,一分钟就能讲完的事

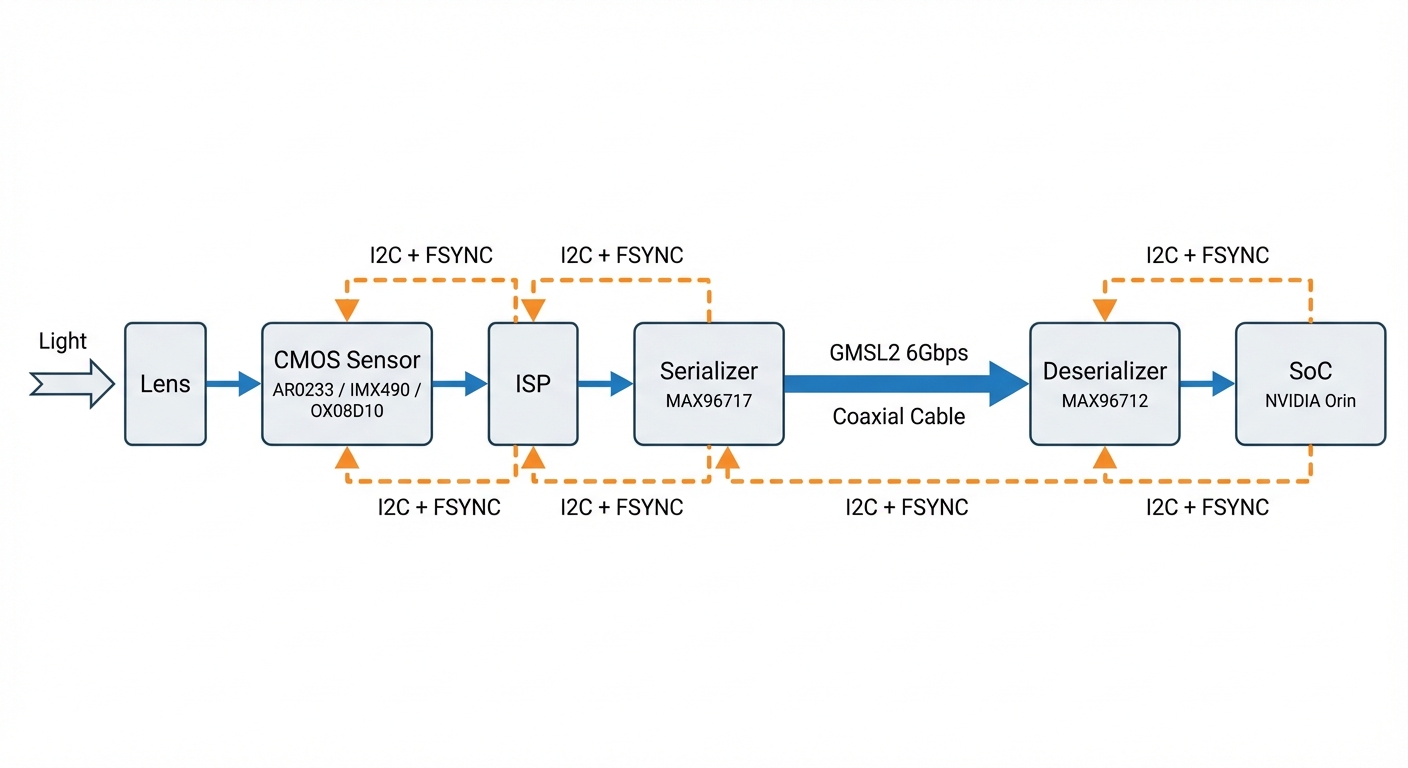

一台相机的核心链路:光线 → 镜头(Lens) → 图像传感器(CMOS/CCD) → ISP → 数字图像输出。

镜头负责聚焦和控制 FOV(视场角),CMOS Sensor 把光子转换为电信号,ISP 完成去马赛克、白平衡、降噪、HDR 合成等一系列图像处理。消费级相机追求画质和色彩还原,工业相机追求帧率和精度,而车载相机——追求的是在极端光照下稳定输出可用图像,并且十年不坏。

这就是车载相机和其他相机的根本区别。不是分辨率越高越好,不是色彩越艳越好,而是 120dB 动态范围下逆光不过曝、隧道不欠曝、LED 信号灯不闪烁,同时在 -40°C 到 105°C 的温度区间里稳定工作十万公里。

车载相机:和消费级完全不同的物种

车载相机和手机相机、工业相机看起来都是「拍照」,但从需求到器件选型完全是两个世界。

车规级要求

车载相机必须通过 AEC-Q100 认证(芯片级)和 AEC-Q104 认证(模组级),核心要求包括:

- 温度范围:-40°C ~ 105°C(Grade 2),部分前视要求 125°C(Grade 1)

- 可靠性:设计寿命 15 年 / 30 万公里,零故障

- EMC:满足 CISPR 25 Class 5 电磁兼容

- 功能安全:满足 ISO 26262 ASIL-B 及以上

车载相机的核心参数

和消费相机盯着像素数不同,车载相机关注的参数优先级是:

动态范围(HDR) > LED 闪烁抑制(LFM) > 分辨率 > 帧率 > 功耗 > 尺寸

动态范围决定了逆光、隧道出入口、夜间对向远光灯这些极端场景下的可用性。LFM 决定了能不能稳定识别 LED 交通灯和 LED 刹车灯——LED 灯以人眼不可见的频率闪烁(通常 90~400Hz),普通相机拍出来会出现明暗交替的条纹甚至完全熄灭的假象,对感知算法来说是致命的。

主流车企的相机选型:以 Tesla 和小鹏为例

Tesla:从 AR0136 到 IMX490 的三代跃迁

Tesla 的相机选型伴随着 HW(Hardware)平台的迭代,是行业里最有代表性的演进路线。

HW3.0(2019~2023)

- 前视三目:主摄 + 长焦 + 广角,共用前风挡安装位

- CMOS Sensor:安森美(onsemi)AR0136AT,1.2MP,1/4” 光学尺寸(据 Greentheonly 拆解披露,也有来源指向 AR0132AT,均为安森美同系列 1.2MP 产品)

- 色彩滤波器:RCCB(Red-Clear-Clear-Blue),不是常规的 RGGB。用两个 Clear 通道替代 Green,进光量更大,暗光性能更好,但颜色还原需要算法补偿

- 分辨率:1280×960(约 120 万像素),以今天的眼光看非常低

- 动态范围:~60dB,HDR 能力有限

- 接口:FPD-Link III(TI 方案),不是 GMSL

- 特点:成本极低,单颗传感器个位数美元。Tesla 的逻辑是用算法弥补硬件,靠大规模数据和神经网络压榨每一个像素的价值

HW4.0(2023~至今)

- 前视双目(取消三目改双目),全车从 8 颗增加到 11 颗

- 前视 CMOS Sensor:索尼(Sony)IMX490,5.4MP,1/1.55” 光学尺寸(据 EDN China 及多个拆解来源,其他位置的相机可能采用 IMX390 等较低规格 sensor,并非全车 11 颗都是 IMX490)

- 色彩滤波器:回归标准 RGGB

- 前视分辨率:2880×1860(约 540 万像素),相比 HW3 提升 4.5 倍

- 动态范围:120dB+,采用 Sony 的 Sub-pixel 技术,单次曝光实现 HDR

- LFM:原生支持 LED 闪烁抑制

- 接口:切换到 GMSL2(Maxim/ADI 方案)

跨代提升非常明显——从 1.2MP/60dB 跳到 5.4MP/120dB,这不只是参数变化,直接决定了感知距离从 ~80m 提升到 200m+。

HW5.0(规划中)

目前信息有限,业界推测会采用更高分辨率(800 万像素级)的传感器,可能继续用 Sony IMX 系列或转向豪威(OmniVision)的新一代产品。

小鹏:鹰眼视觉与 OX08D10

小鹏的演进路线和 Tesla 类似,但在 P7+ 这一代上走了一条不同的技术路径。

早期车型(P7/P5/G9)

- CMOS Sensor:主要采用安森美 AR0233AT(Hayabusa),2.6MP,1/2.5” 光学尺寸

- AR0233 是车载相机领域的「标准答案」,几乎所有 Tier1 的 ADAS 模组都以它为基础。HDR 性能优秀(>100dB),LFM 支持好,搭配 MAX96717(串行器)+ MAX96712(解串器)走 GMSL2 链路

- 分辨率 1920×1200,2MP 级别,满足 L2+ 需求

P7+(2024~):AI 鹰眼视觉

- 前视 CMOS Sensor:豪威(OmniVision)OX08D10,8MP,1/1.73” 光学尺寸

- 核心技术:TheiaCel™ 技术——基于下一代横向溢出积分电容(LOFIC)+ 豪威 DCG HDR,单次曝光实现 HDR + LFM

- 分辨率:3840×2160(4K 级),800 万像素

- 动态范围:相比上一代非 LOFIC 产品,LFM 动态范围提高 3.3 倍,总动态范围提高近 3 倍

- 尺寸:比同级别传感器小 50%

- 配置:前视 + 后视共 3 颗 800 万像素摄像头(舜宇镜头),侧视仍为 2MP 级

- 感知距离:官方宣称提升 125%,识别速度提升 40%

- ISP:indie GW5300

- 串行器:Maxim MAX96717G + GMSL2 链路

小鹏在 P7+ 上选择豪威而非索尼,核心原因是 OX08D10 的 TheiaCel 技术在 LFM 上的表现更优——对国内 LED 交通灯的适配非常关键。

其他车企选型速览

(以下信息整理自公开拆解报告和行业分析,具体型号可能因车型和批次不同有差异)

| 车企/平台 | 代表 CMOS | 分辨率 | 供应商 | 接口 |

|---|---|---|---|---|

| 蔚来 NT2.0 | AR0820 / OX08B | 8MP | 安森美 / 豪威 | GMSL2 |

| 理想 AD Max | AR0820 | 8MP | 安森美 | GMSL2 |

| 华为 MDC | OX08B / IMX728 | 8MP | 豪威 / 索尼 | GMSL2 |

| Mobileye EyeQ6 | AR0234 / AR0820 | 2~8MP | 安森美 | GMSL2 / FPD-Link |

行业趋势很清晰:前视 8MP 已经成为高阶智驾标配,传感器三巨头(索尼、安森美、豪威)各有千秋,GMSL2 成为压倒性的主流接口方案。

硬核拆解:CMOS → 串行器 → 线缆 → 解串器 → ISP → SoC

一帧图像从光子变成神经网络的输入张量,要经过一条完整的信号链路。下面逐个环节拆开讲。

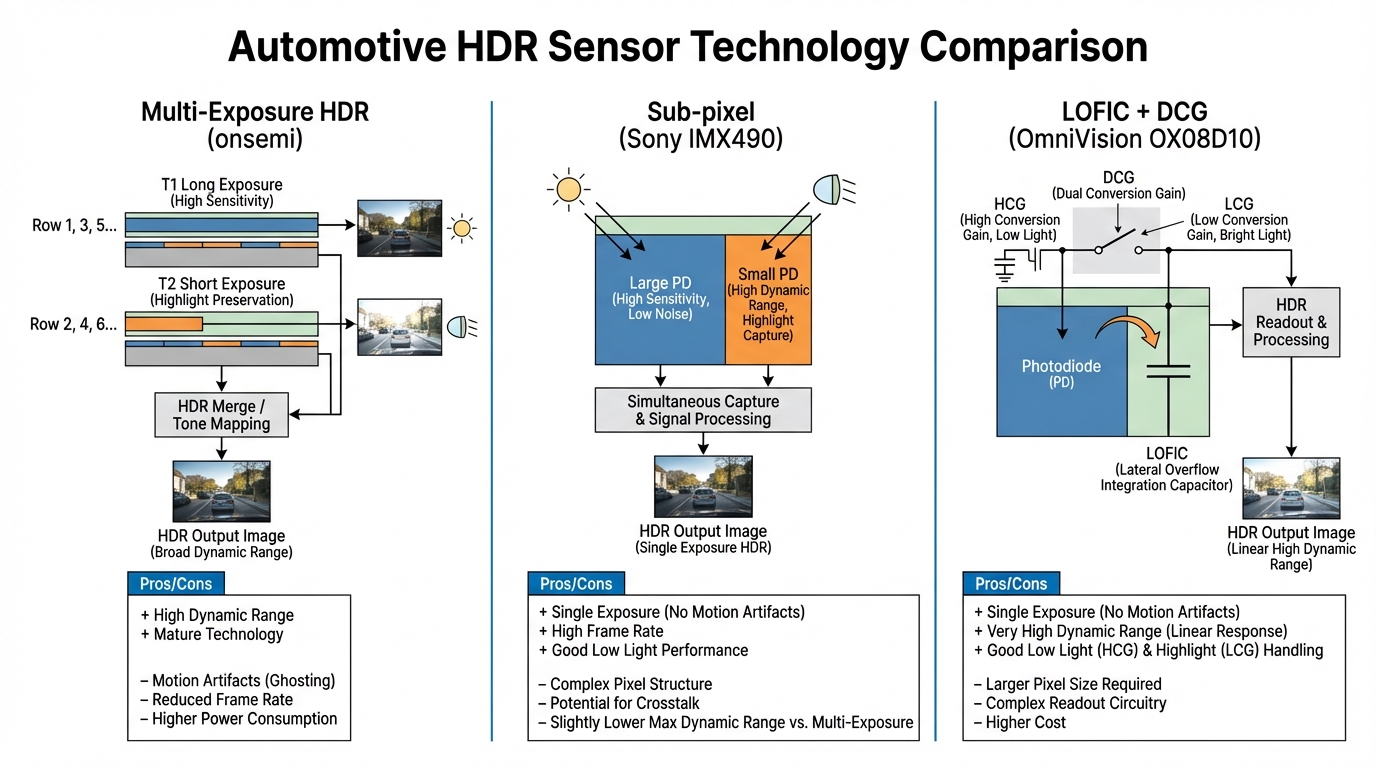

CMOS Sensor:三巨头的 HDR 技术路线

前面按车企维度讲了「用什么」,这里按供应商维度讲「为什么」——三家的 HDR 实现路径完全不同,这是车载 CMOS 最核心的技术分野。

安森美(onsemi)—— 多曝光合成派

代表型号路线:AR0136 → AR0233 → AR0820 → AR0823。核心技术是 SuperExposure™ 像素架构:同一帧内不同行用不同曝光时间,合成一张 HDR 图像。成熟、成本低、生态最好,但运动场景下行间曝光时差会产生伪影。AR0820 是 8MP 旗舰,但功耗和发热相比竞品偏高。

索尼(Sony)—— Sub-pixel 派

代表型号路线:IMX390 → IMX490 → IMX728。核心技术是 Sub-pixel 架构:单像素内集成大小两个光电二极管,大管感弱光、小管感强光,同时曝光后融合。零运动伪影、HDR 性能最高,但像素面积大、成本高、供货周期长。IMX728 是 8MP 旗舰,面向 L3+ 平台。

豪威(OmniVision)—— LOFIC + DCG 派

代表型号路线:OX03C → OX05B → OX08B → OX08D10。核心技术是 TheiaCel™:横向溢出积分电容(LOFIC)存储高光电荷 + 双转换增益(DCG)切换,单次曝光同时实现 HDR 和 LFM。LFM 表现目前最优,尺寸最小,性价比高。相对较新,量产验证时间还短,品牌认知度和索尼有差距。

HDR 技术路线对比

| 技术路线 | 代表 | 原理 | 优点 | 缺点 |

|---|---|---|---|---|

| 多曝光合成 | 安森美 SuperExposure | 同一帧内不同行用不同曝光时间,合成 HDR | 成熟、成本低 | 运动场景有伪影(行间曝光时差) |

| Sub-pixel | 索尼 IMX490 | 单像素内大小二极管同时曝光,大管感弱光、小管感强光 | 零运动伪影、HDR 最高 | 像素面积大、成本高 |

| LOFIC + DCG | 豪威 OX08D10 | 横向溢出电容存储高光电荷 + 双转换增益切换 | LFM 最优、尺寸最小 | 相对较新,量产验证时间短 |

串行器(Serializer)与解串器(Deserializer)

车载相机挂在保险杠、翼子板、前风挡等各种位置,离域控制器(SoC)有 5~15 米的距离。CMOS Sensor 输出的 MIPI CSI-2 信号是并行的短距离接口,根本传不了这么远。这就是串行器和解串器存在的意义。

GMSL2(Gigabit Multimedia Serial Link 2)

事实标准。Maxim(现已被 ADI 收购)的方案,几乎垄断了车载相机的高速传输市场。

数据链路:

CMOS Sensor → MIPI CSI-2 → 串行器(Serializer) → 同轴线缆(GMSL2 正向通道,最高 6Gbps) → 解串器(Deserializer) → MIPI CSI-2 → SoC

反向通道:

SoC → 解串器 → GMSL2 反向通道(低速,用于 I2C 控制和 FSYNC 触发信号) → 串行器 → CMOS Sensor

一根同轴线缆(通常是 FAKRA 接口),同时承载正向的高速视频数据和反向的控制/触发信号,这是 GMSL2 最优雅的设计。

常用型号

| 角色 | 型号 | 关键参数 | 典型搭配 |

|---|---|---|---|

| 串行器 | MAX96717 / MAX96717F | GMSL2,正向 6Gbps,支持 MIPI CSI-2 4-lane | 相机端,和 CMOS Sensor 封装在一起 |

| 串行器 | MAX96715 | GMSL1(旧方案),正向 1.5Gbps | 低分辨率环视相机 |

| 解串器 | MAX96712 | GMSL2,4 路输入,输出 MIPI CSI-2 4×4-lane 或 2×4-lane | 域控端,单片接 4 路相机 |

| 解串器 | MAX96724 | GMSL2,4 路输入,支持更高带宽 | 下一代平台 |

| 解串器 | MAX9296 | GMSL2,2 路输入 | 较老平台或低路数配置 |

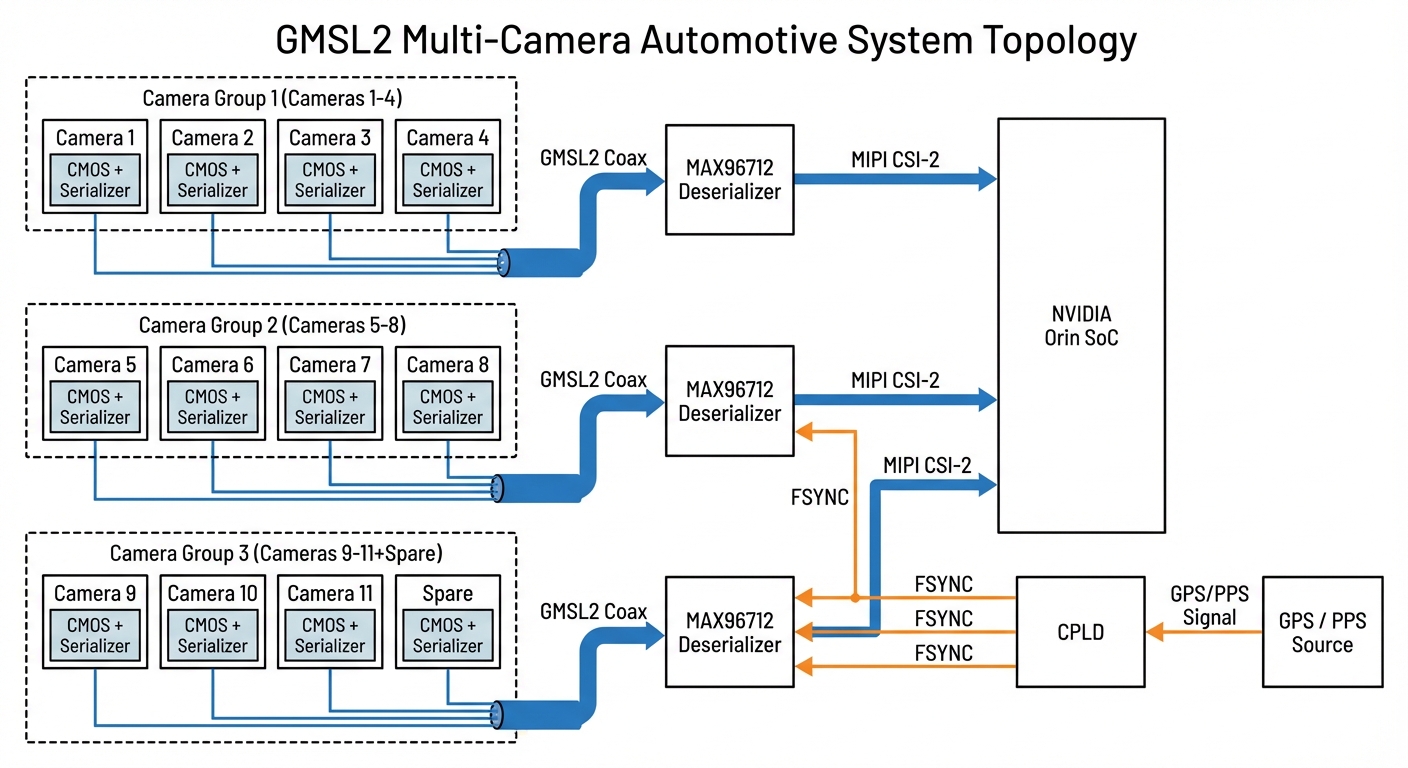

典型车端配置

以单 Orin 平台 + 11 路相机为例:

- 3 片 MAX96712(每片接 4 路) → 共支持 12 路,实际接 11 路

- 每片 MAX96712 通过 MIPI CSI-2 连接到 Orin 的 CSI 接口

- Orin 有 16 lane MIPI CSI-2 输入,理论支持 16 路相机

FPD-Link(TI 方案)

Texas Instruments 的竞品方案,Tesla HW3 曾经使用。目前在新平台上已被 GMSL2 大面积替代,但在一些低成本 L2 方案中仍有使用。

ISP(Image Signal Processor)

CMOS Sensor 输出的是 RAW 数据(Bayer 格式),必须经过 ISP 处理才能变成可用的 RGB/YUV 图像。ISP 的位置有三种选择:

方案一:Sensor 内置 ISP

部分 CMOS Sensor 内部集成了基础 ISP(如安森美的 AR0233 支持内部 ISP bypass 或使能)。优点是链路简单,缺点是调优空间有限。

方案二:独立 ISP 芯片

在串行器之前加一颗专用 ISP,典型如 indie GW5200/GW5300。好处是 ISP 调优完全独立于 SoC,画质可控性最强。小鹏 P7+ 的 OX08D10 就搭配了 GW5300。

方案三:SoC 内置 ISP

NVIDIA Orin 内置了强大的 ISP 引擎,可以直接接收 RAW 数据并在片内完成 ISP 处理。这是目前高阶智驾平台的主流方案——相机端输出 RAW,走 GMSL2 传到域控,Orin 内部 ISP 统一处理。

好处:所有相机的 ISP 参数统一管理,便于一致性调优和 OTA 升级。

坏处:对 GMSL2 带宽要求更高(RAW 数据量比 YUV 大 ~1.5 倍),Orin ISP 的处理路数有上限。

三种方案的选择

| 方案 | 适用场景 | 代表 |

|---|---|---|

| Sensor 内置 ISP | 低成本 L2,环视 | AR0233 内置 ISP |

| 独立 ISP 芯片 | 对画质有极高要求的前视 | OX08D10 + GW5300 |

| SoC 内置 ISP | 高阶智驾平台主流 | Orin ISP + RAW 输入 |

时间同步:多传感器融合的基石

自动驾驶车上有 812 颗相机和 13 颗 LiDAR,它们必须在同一时刻看到同一个世界。如果相机 A 拍的是 100ms 前的画面,相机 B 拍的是当前画面,融合出来的 BEV 特征就是错的。

同步架构:PTP + CPLD 硬触发

典型的多传感器时间同步采用两层架构:

- 第一层(时钟对齐):PTP(IEEE 1588)协议,让所有设备共享同一个时钟域。Orin 作为 PTP Master,LiDAR 作为 PTP Slave,精度可达 <1μs

- 第二层(采集同步):CPLD 产生硬件触发脉冲(FSYNC),通过 GMSL2 的反向通道分发到每个相机,控制曝光起始时刻

FSYNC 触发链路

CPLD → FSYNC 脉冲 → 解串器(MAX96712)→ GMSL2 反向通道 → 串行器(MAX96717)→ External Trigger → CMOS Sensor 曝光

所有相机共用一个 FSYNC 源,相机间同步精度可以做到 <10μs。相机与 LiDAR 之间,如果 LiDAR 支持 sync-in 硬触发(如速腾 AT128、图达通灵雀W),可以做到 <50μs。像 Livox Mid360 这种没有 sync-in 的,只能靠 PTP 时间戳做软对齐,精度会退化到百微秒到低毫秒级。

工程上的坑

原理很清晰,但实操中有几个容易翻车的地方:

- GMSL2 FSYNC 反向通道延迟:触发信号从解串器通过反向通道传到串行器再到 sensor,存在几微秒到十几微秒的传播延迟,不同 Deserializer 片间的延迟还不一样。必须用示波器实测,然后在 CPLD 里做逐片补偿

- Rolling Shutter 的曝光中心计算:相机使用 AE 时,每帧曝光时长不同。精确的时间戳不是触发时刻,而是 timestamp = trigger_time + exposure_time / 2。曝光时长从 Sensor 的 Embedded Data 或寄存器读取。如果用的是 Rolling Shutter,不同行的曝光时刻还有微小偏移,做点云-图像融合时需要逐行补偿

- PTP 同步质量监控:实际车端运行时,网络拓扑变化、温漂、主时钟源切换都可能导致 PTP offset 抖动,需要持续监控

ptp4l的 offset 和 delay 指标,超过阈值就要报警或降级

还有哪些问题没解好?

车载相机的硬件链路看起来成熟,但实际工程中仍然有不少棘手问题。

1. 曝光控制与场景适应

自动曝光(AE)算法在大多数场景下工作正常,但在以下场景容易翻车:

- 隧道出入口:0.5 秒内光照变化 4~5 个数量级,AE 响应速度跟不上

- 逆光 + 阴影交替:树荫路段、高架桥下,AE 在亮暗之间反复震荡

- 大面积天空/地面:AE 被天空的高亮度「骗」了,导致路面目标欠曝

Tesla 的做法是在 ISP 层面定制 ROI 加权 AE(对路面区域给更高权重),同时靠神经网络的鲁棒性去容忍一部分曝光偏差。小鹏在 P7+ 上用独立 ISP(GW5300)做更精细的分区 AE 调优。

但根本性的解决思路是——让感知算法直接吃 RAW 数据,绕开 ISP 的信息损失。这是学术界和工业界都在推的方向,RAW 数据保留了 Sensor 的全部动态范围信息,理论上比 ISP 处理后的 RGB 图像对网络更友好。

2. Rolling Shutter 伪影

目前主流车载 CMOS 都是 Rolling Shutter(卷帘快门),不是 Global Shutter。卷帘快门的每一行像素曝光时刻不同,高速运动或车身振动时会产生图像畸变(倾斜、果冻效应)。

对感知的影响:高速行驶中,目标在图像上下边缘的位置会有 1~2 个像素的偏移,直接影响 3D 检测的深度估计精度。

Global Shutter 的车载 CMOS 正在逐步量产(如 onsemi AR0234CS),但目前 HDR 和动态范围性能不如 Rolling Shutter 方案,成本也更高。这是一个 trade-off。

3. GMSL2 带宽瓶颈

GMSL2 单路最高 6Gbps。对于 8MP@30fps RAW12 的数据流:

8MP × 12bit × 30fps = 2.88Gbps

看起来够用,但加上行消隐、帧消隐和协议开销,实际占用约 3.5~4Gbps,已经接近 6Gbps 上限的 60%~70%。如果未来传感器升级到 12MP 或更高帧率,GMSL2 就会成为瓶颈。

Maxim/ADI 已经在推 GMSL3,带宽提升到 12Gbps+,同时引入了确定性延迟和更强的功能安全特性。

4. Sensor 脏污和退化

相机装在车外,长期经受雨水、灰尘、虫子、鸟粪的考验。镜头脏污直接导致图像模糊或局部遮挡,对感知的影响是灾难性的。

当前的解决方案:

- 自清洁:部分高端车型在前视摄像头上集成了喷水清洗装置

- 脏污检测:通过图像分析或专用 AI 模型检测镜头脏污状态,触发告警或降级

- 加热除雾:在寒冷环境下对镜头加热防止起雾和结冰

但长期的镜头老化(紫外线劣化、划痕)是无法完全解决的,只能通过定期更换和在线标定补偿。

5. 未来方向

- 更高分辨率:12MP~16MP 前视相机已在研发中,支撑 300m+ 的感知距离

- GMSL3:12Gbps+ 带宽,满足更高分辨率和帧率的传输需求

- RAW 域感知:跳过 ISP,让神经网络直接处理 RAW 数据,最大化利用 Sensor 动态范围

- 计算摄影:将深度学习引入 ISP pipeline,实现 AI-ISP,让图像处理本身就针对下游感知任务优化

- Event Camera(事件相机):异步输出像素级亮度变化事件,动态范围可达 140dB+,延迟低至微秒级。目前还在研究阶段,但被认为是下一代车载视觉传感器的重要候选

- 4D 成像雷达 + 视觉融合:不是取代相机,而是在相机失效场景(暴雨、大雾、强逆光)提供冗余感知

写在最后

我自己做低速无人车的感知,对车载相机的体感是:硬件选型的决策往往不是技术最优,而是综合成本、供应链、部署约束和算法能力之后的平衡点。我们用的是 3MP 的 Sony ISX031,规格比 Tesla HW3 的 AR0136 还高一档,但和主流乘用车的 8MP 前视比就是另一个世界。低速场景下 3MP 配合定制 ISP 和针对性的数据增强已经够用,而高速场景的同行们已经在用 8MP 前视 + RAW 域输入了。

技术在迭代,但核心问题始终是同一个:如何在成本和约束范围内,让相机的每一个像素都产生最大的感知价值。